5月15日消息,OpenAI令人瞩目地推出了其最先进的AI模型——GPT-4o,此模型作为GPT-4的迭代升级,标志着AI技术的又一里程碑。

GPT-4o凭借其“全知全能”(Omni)的设计理念,不仅限于文本处理,更将实时语音识别与视觉理解纳入其强大能力范畴,实现了跨模态的实时推理与处理。这一创新之举使得GPT-4o能够以更为流畅和综合的方式,与诸如ChatGPT等对话应用进行对接,极大地提升了人机交互的自然度与效率。

用户将体验到前所未有的多维度信息交流,无论是输入文本、语音还是图像,GPT-4o都能精准理解并给出相应的高质量响应,开启了一个AI全面融合多种感官输入的新时代。

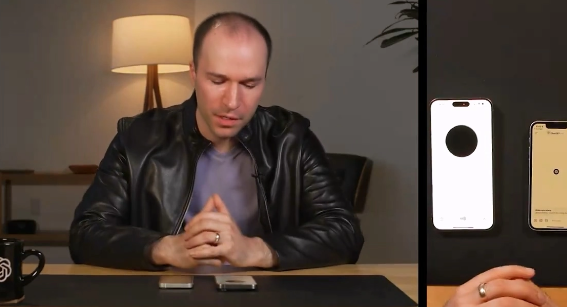

OpenAI 总裁兼联合创始人格雷格·布罗克曼(Greg Brockman)随后发布了上手演示,让两台运行 GPT-4o 的设备进行语音或视频交互。

布罗克曼在演示开始之前,表达了自己的期望:让两台 AI 聊天机器人互相交流。布罗克曼向其中 A 聊天机器人讲述了他的期望,并让 B 聊天机器人可以调用摄像头观察周围世界。

B 聊天机器人会调用前置摄像头,并清晰地描绘出用户的穿着和所处的环境。然后 A 聊天机器人可以与它对话并提出问题,包括移动摄像头和它所看到的内容。

对话中,新版本 ChatGPT 不仅能通过视觉 AI 能力理解摄像头中发生的事情,同时还能够将理解的内容通过语音交互,进行更加丰富有趣的互动,同时还支持中途打断和对话插入,且具备上下文记忆能力。

文明上网,理性发言,共同做网络文明传播者