近日消息,北京智谱华章科技有限公司宣布,其旗下的CogVideoX系列模型已更新至最新版本——CogVideoX v1.5,并且该版本已经对外开源。自8月初首次发布以来,CogVideoX系列凭借其先进的技术和开发者友好的特性,在视频生成领域取得了显著的成就。

此次发布的v1.5版本在前一版本的基础上进行了重要升级,特别是在视频生成能力上有了明显提升,现在可以支持生成5秒或10秒、分辨率达到768P、帧数为16帧的视频内容。此外,I2V模型也得到了改进,能够支持任意尺寸比例的图像到视频转换,进一步提高了生成视频的质量及对复杂语义的理解能力。

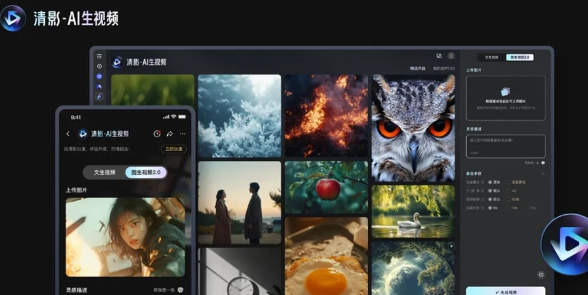

此次开源的内容包括两个模型:CogVideoX v1.5-5B和CogVideoX v1.5-5B-I2V。新版本也将同步上线到清影平台,并与新推出的CogSound音效模型结合,提供质量提升、超高清分辨率支持、可变比例适应不同播放场景、多通道输出以及带声效的AI视频等特色服务。

在技术层面,CogVideoX v1.5通过自动化筛选框架过滤了缺乏动态连通性的视频数据,并采用端到端的视频理解模型CogVLM2-caption生成精准的视频内容描述,提升了文本理解和指令遵循能力。此外,新版本采用了高效的三维变分自编码器(3D VAE)解决内容连贯性问题,并自主研发了融合文本、时间和空间三维度的Transformer架构,取消了传统的跨注意力模块,通过专家自适应层归一化技术优化了扩散模型中时间步信息的利用。

训练方面,CogVideoX v1.5构建了一个高效的扩散模型训练框架,通过多种并行计算和时间优化技术,实现了对长视频序列的快速训练。公司表示,他们已验证了scaling law在视频生成领域的有效性,并计划在未来扩大数据量和模型规模,探索创新模型架构,以更高效地压缩视频信息,并更好地融合文本与视频内容。

文明上网,理性发言,共同做网络文明传播者