近日,蚂蚁集团在多模态AI领域取得重要突破,成功研发出参数规模高达20亿的SkySense多模态遥感基础模型,并已得到计算机视觉顶级国际会议CVPR2024的认可,入选其学术论文发表名单。这一成果再次彰显了蚂蚁百灵大模型团队在技术创新上的领先实力。

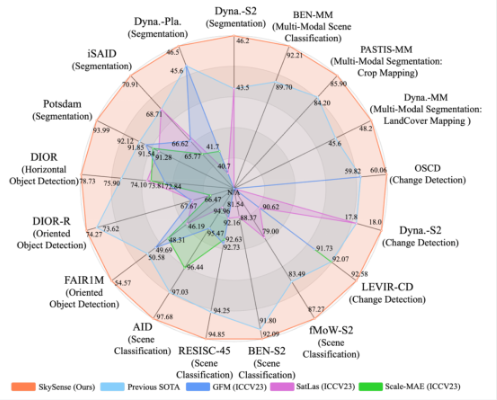

数据显示,SkySense在17项测试场景中指标均超过国际同类产品,这也是迄今为止国际上参数规模最大、覆盖任务最全、识别精度最高的多模态遥感基础模型。SkySense可用于地貌、农作物观测和解译等,有效辅助农业生产和经营。

随着人工智能的发展,大模型技术与卫星遥感技术相结合产生了新突破。SkySense是蚂蚁集团基于蚂蚁百灵大模型平台能力开发的多模态遥感模型。

SkySense在总计17项国际权威公开数据集进行了测评,其测试任务类型包括了土地利用监测、高分辨率目标识别、地物变化检测等7种常见遥感感知任务,并与国际上已发布的包括IBM和NASA联合研发的Prithvi等共18个全球主流同类模型做了测试结果比较。

数据显示,17项测评中SkySense均名列第一。譬如,在国际高清遥感地物检测榜单FAIR1M2.0中,SkySense平均精度(mAP)领先第二名超3%。

在刚刚公布的CVPR2024论文入选结果上,SkySense的研究成果亦被收录。CVPR是由IEEE举办的计算机视觉和模式识别领域的顶级会议,是国际计算机视觉三大顶会之一。

传统的遥感影像理解技术,往往侧重于针对单一模态单一任务建模,缺乏对多模态数据、时间序列、地理先验知识的综合建模和利用,限制了其在海量数据和多种任务中的泛化能力。SkySense突破以上技术瓶颈,实现了文本、红外光、可见光、SAR雷达多种模态、多分辨率的时序遥感影像建模,在多样化的任务中展现出优异性能。

在蚂蚁百灵大模型多模态能力支持下,研发人员基于内部构建的19亿遥感影像数据集进行预训练,得到了20.6亿参数量的模型SkySense,这也是迄今为止国际上参数规模最大、覆盖任务最全、识别精度最高的多模态遥感大模型。SkySense可广泛应用于城市规划、森林保护、应急救灾、绿色金融、农业监测等重要领域,目前通过蚂蚁内部MEarth平台提供数据与识别服务。

据了解,蚂蚁集团正在计划开放Skysense模型参数,与行业共建,促进智能遥感技术与应用发展。

SkySense由蚂蚁AI创新研发部门NextEvo与武汉大学联合研发。NextEvo是蚂蚁AI核心技术研发团队,主导了蚂蚁百灵大模型的研发工作,其研发方向涉及CV、NLP、多模态、AIGC、数字人、AI工程化等核心技术。去年,该部门升级了多模态团队,由杨铭带队全面布局多模态技术。

杨铭美国西北大学博士,FacebookAIResearch(FAIR)创始成员,去年加入蚂蚁集团,先后就职于NEC美国实验室、FAIR、地平线机器人公司,是世界知名计算机视觉研究专家。

目前,蚂蚁集团多模态研究成果已应用于支付宝五福节AI大规模互动、蚂蚁医疗数字人等场景。

文明上网,理性发言,共同做网络文明传播者