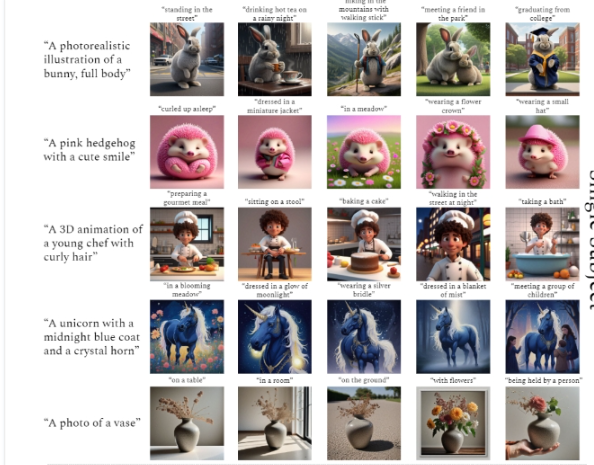

近日,英伟达与特拉维夫大学的研究团队合作研发出一款新颖的文本到图像生成模型——ConsiStory。这款模型当前尚未对外开源,其核心目标是针对现有文生图模型在内容连贯性与一致性生成方面的瓶颈问题提出解决方案。

ConsiStory 模型通过深度学习技术和创新算法设计,力求在理解输入文本深层含义的基础上,精准地生成与文本描述高度一致且逻辑连贯的图像内容。这一突破性的研究有望提升AI在跨模态理解和生成任务上的表现,进一步拓宽应用场景并优化用户体验。

ConsiStory 采用了一种全新的方法,通过主体驱动自注意力(SDSA)和特征注入等核心模块,实现了图像主体的一致性,无需任何训练或调优。

SDSA 模块是 ConsiStory 的核心之一,扩大了扩散模型中自注意力层,允许不同图像中的主体保持一致的外观。通过主体蒙版遮蔽背景区域的敏感信息,不同图像中的主体可以相互 ”对齐”,保持一致性。而特征注入则建立在扩散特征空间的密集对应图上,确保主体相关的纹理、颜色等细节特征在整个批次中互相 ”对齐”,进一步增强了主体间的一致性。

此外,ConsiStory 还提供了锚图像和可重用主体功能,锚图像作为主题信息的参考,引导图像生成过程以保持一致性。可重用主体则通过共享预训练模型的内部激活,避免了传统方法中针对每个主题进行训练的难题,实现了0训练成本。这些功能共同助力 ConsiStory 成为一款无需训练即可生成连贯图片的文生图模型,为 AI 图像生成领域带来了新的可能性。

文明上网,理性发言,共同做网络文明传播者