8月22日消息,科技媒体发布博文,微软Copilot Studio被曝出存在服务器端请求伪造(SSRF)的重大安全漏洞,这一漏洞恐导致云环境中敏感数据的外泄。

该发现再次敲响了云计算安全的警钟,提醒用户和开发者们需密切关注此类工具的安全更新与防护措施,以防止潜在的数据泄露风险。

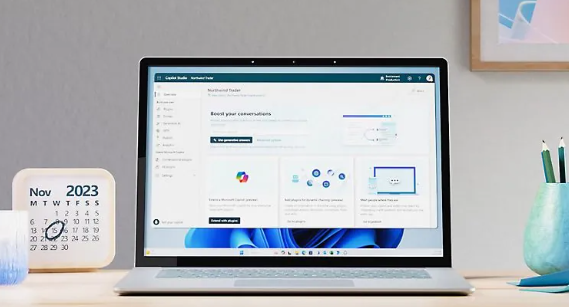

微软 Copilot Studio 简介

Copilot Studio 是一个端到端对话式 AI 平台,支持你使用自然语言或图形界面创建和自定义助手。用户使用 Copilot Studio,可以轻松设计、测试和发布满足内部或外部场景的需求。

漏洞

研究人员利用微软 Copilot Studio 工具中的一个漏洞,能够发出外部 HTTP 请求,从而访问云环境中有关内部服务的敏感信息,并潜在影响多个租户。

Tenable 的研究人员在聊天机器人创建工具中发现了服务器端请求伪造(SSRF)漏洞,他们利用该漏洞访问了微软的内部基础架构,包括实例元数据服务(IMDS)和内部 Cosmos DB 实例。

该漏洞被微软追踪为 CVE-2024-38206,根据与该漏洞相关的安全公告,经过验证的攻击者可以绕过 Microsoft Copilot Studio 中的 SSRF 保护,通过网络泄漏基于云的敏感信息。

文明上网,理性发言,共同做网络文明传播者